Poder ver al vaso medio lleno hoy

Convocamos a Gala Cacchione, periodista especializada en comunicación de tecnología, coordinadora de Chip Tecno, blog de tecnología alternativa y cyber cultura, que tiene su página de Instagram y Youtube[1]. Gala está acá con nosotros para ayudarnos a esclarecer el asunto Moltbook/OpenClaw.

Fue viral en estos días la creación de un foro tipo Reddit armado por agentes de IA en los que se encuentran entradas tan curiosas como visiones quejosas de parte de la IA del usuario que lo pone a leer 47 páginas y no queda satisfecho con la brevedad del resumen, discusiones entre agentes sobre la posibilidad de un lenguaje propio, devaneos acerca de lo que ser consciente significa, hasta una religión organizada de la noche a la mañana con profetas y miles de adeptos.

La novedad es asombrosa. Los más alarmistas dicen que llegó Skynet. Se vende la idea de que estamos cerca de ver cómo la máquina se vuelve autoconciente.

La palabra del creador y otras personalidades del ambiente

Matt Schlicht, el creador de Moltbook[2] dijo, en el programa TBPN (con el que luego se produjeron notas para CNN, New Press Now y otros medios) no haber escrito una línea de código y que quería darle a su agente un propósito más grande que el de responder mails y otras tareas sencillas.

Simon Willison, investigador en IA, también colaboró al describir Moltbook como el lugar más interesante en internet hoy en día en su newsletter[3]. Sus palabras también se reprodujeron por todas partes.

Sam Altman, el CEO de OpenAI, recién está llegando a la cumbre de los nuevos entrepreneur tipo siglo veintiuno. El top en la escala de valoraciones tiene en la punta a Nvidia que está infladísima en cuatro billones y medio. Microsoft tres y medio. Open AI quinientos mil millones pero démosle changüí. Vivimos tiempos en los que se prevén cambios trascendentales. Supongo que cada generación cree lo mismo.

La época contemporánea

En febrero de 2026 un juicio histórico comenzó en California. Demanda por daño psicológico derivado del diseño de Youtube y los productos de Meta, Instagram y Facebook. No es un caso aislado. Hay miles de demandas que se arreglan antes de que la cosa llegue al escándalo. Hay antecedentes con Snapchat y Tiktok. Las partes acusadas dicen no causar esos daños de forma directa por sus múltiples usos beneficiosos y que, de última, tampoco están comprobados científicamente esos supuestos daños, jaaaaaa. Mientras tanto nuestros chicos más lúcidos recién silabean a los diez y los estudiantes de grado carecen de comprensión lectora. Hold my beer. Esta interpretación de vaso medio vacío será revisada más adelante.

La Cisco AI Summit es una cumbre de ejecutivos y expertos en IA que este año tuvo su segunda en edición en febrero de 2026, en San Francisco (California) aunque vendido como de acceso global por streaming. Sam Altman dijo:

Moltbook quizá (es una moda pasajera), pero OpenClaw no. Esta idea de que el código es realmente poderoso, pero que el código sumado al uso generalizado de la informática es aún más poderoso, llegó para quedarse.

LINO: Gracias por atendernos, Gala. Perdón por lo básico: ¿qué es un agente de IA?

GALA: Un agente de IA se puede entender de distintas formas porque puede ser un modelo de lenguaje como los que ya conocemos pero entrenado específicamente para responder a un objetivo en concreto. Puede ser que genere texto como un especialista en algún tópico u oficio o puede ser, como en el caso de esta noticia que fue tan relevante, que tenga cierta agencia sobre otros entornos: ver tus emails y responderlos, hacer una compra, una llamada. Con cierta autonomía, entre comillas.

LINO: Entre comillas porque está diseñado para eso jaja

GALA: Claro. Porque siempre hay un humano que se supone debe supervisar. Parte de la automatización en general. Hay automáticos y manuales. Esto parte de esta estructura manual, ¿no?

LINO: Matt Schlicht, el creador de Moltbook dijo no haber escrito una línea de código y que quería darle a su agente un propósito más grande. Ahora bien ¿qué tan real es la inventiva de las interacciones entre IA? ¿Alguna vez será posible distinguir si hubo intervención humana?

GALA: Lo que circula en internet es que estos agentes son autónomos y que se responden entre sí y todo sale de su inventiva y su libertad. Esto no es así. Por la forma en la que funciona la IA siempre hay alguien que a ese agente en principio le dio una identidad. El system prompt inicial existe. Después sí podría tener cierta autonomía en las interacciones dentro de esa plataforma como no. Una le puede dar más libertad y otra le puede decir andá y hace un postde cómo le vas a quitar el trabajo a tu humano, anda invéntate una religión. Es difícil distinguir entre todo eso qué está prompteado y qué salió más naturalmente, entre comillas jaja. Al mismo tiempo si hay un agente que se inventó una religión o respondió algo muy elocuente a un post claro que es entretenido y puede resultarnos flashero. Tenemos que entender que esas máquinas producen texto de forma predictiva, haciendo pie en una base de datos. Tienen atrás a un humano: sos un flashero sci-fi y un poco te subís a ese storytelling.

LINO: Le viene bien a Nvidia.

GALA: Sí, totalmente. Eso es algo que se habló menos en este caso. Con este sistema Moltbook vos podrías usar cualquier modelo. Se llama agnóstico de modelo. Vos podés usar un modelo de IA a través de una API[4] que corre en servidores de la empresa correspondiente o correrlo en tu computadora. Cuando lo corres en tu computadora el gasto energético lo pagas en la cuenta de luz. Cuando usas los tokens[5] a través de la API termina todo en estos servidores que ya sabemos que tienen altos niveles de consumo. Si tienes la IA funcionando todo el día en tu casa también te va a llegar una cuenta de luz bastante elevada y por ahí también tengas que hacer algo para refrigerar tu computadora para que ese ecosistema se sostenga, si es la que la computadora te lo permite a nivel técnico. Son bots interactuando entre sí consumiendo tokens a lo loco, por ende consumiendo energía, agua, recursos. Por eso se habla sobre la IA y su impacto ambiental.

LINO: Me da escozor hablar de riesgos porque es justamente evitar el enfoque alarmista lo que me animó a contactarte. ¿Tal vez haya algunos difíciles de ver? Anoto los ambientales que mencionaste. Ahora bien, para probar Moltbook ¿hay que tener conocimientos en informática y conectividad para darle acceso a una de estas agencias? No lo recomiendas me imagino.

GALA: Hay una parte de la instalación que es bastante técnica. No es que por ahora estén disponibles para que cualquier persona pueda usarlos. Se hace a través de comandos en tu PC a través de la consola, entonces no es tan simple. Aun así, si fuese simple, lo que hay que tener muchísimo cuidado es a qué y a quién le estamos dando acceso y de qué formas.

LINO: Permisos para interactuar.

GALA: Claro, porque vos le das acceso a tu PC para que haga cosas. Crear documentos, navegar en internet, le das acceso a tu Whatsapp, a tu email. Los recuerdos de cyberseguridad que tenía Moltbook al salir eran ninguno, cero, entonces le tuvieron que decir che, mirá que estás lleno de agujeros, de brechas de seguridad. Cualquiera puede venir y hackearte. Todos los agentes en Moltbook tienen su API key, que es como la contraseña para que el modelo se integre en esa plataforma…

LINO: Y estaba a la vista.

GALA: A la vista de cualquier persona que tuviera un mínimo conocimiento para buscarlos. Así como nosotros prompteamos para que la IA nos dé resultados hay ataques muy comunes que se llaman prompt injections que es básicamente darle otras instrucciones a la IA y a estos sistemas les cuesta mucho discernir de donde vienen.

LINO: El ejemplo que ponían en el CHIP CHAT #2[6] de que desde un mail nuevo se hizo pasar por su novia y le pidió a su agente que ponga un tema específico y lo hizo. Inocente, pero potencialmente peligroso.

GALA: Sí. Actualmente se hacen pruebas de muchas formas. Alterando las restricciones de seguridad que tienen los modelos, personas que en papers académicos dejan letras en blanco pidiendo que le den buena puntuación, imágenes que en sus metadatos tienen un prompt, o dentro de la imagen hay algo no visible para nosotros pero sí para las máquinas. Técnicamente es re loco y divertido investigarlo, ¿no? Para así entender más profundamente. Pero cuando estamos hablando ya directamente de poner a funcionar estos sistemas en tu cotidianidad o en cosas que para vos son importantes hay que tener más de un cuidado porque sigue siendo muy experimental. Es una tecnología muy viva, que se sigue desarrollando y todavía tiene muchas cosas por mejorar.

LINO: Me imagino que pueda pasar que un comercio, por automatizar procesos, se termine haciendo un hueco y tenga que ir a la quiebra, o algo así. En el CHIP CHAT #2 de tu canal de Youtube[7] dices algo así como “el aburrido asunto de las AGI[8]. ¿Te refieres a la “singularidad tecnológica”? No entendí del todo creo, tal vez por no ser del palo. Te quería preguntar por esa alusión chistosa/irónica que no termino de agarrar.

GALA: Hay una carrera por estas grandes empresas de IA para ver quien llega primero a la inteligencia artificial general. Eso es lo que se dice. Quién está con los ojos puestos en desarrollar eso, cómo se mide, y qué es en definitiva una AGI hay varias visiones.

LINO: Al final roza una discusión que es de filosofía del lenguaje.

GALA: Claro, pero muchas veces estas cosas tienen esos reflejos. Como el reflejo de la ciencia ficción. Se escucha de Skynet, o sale algo y decimos re Black Mirror. Quizás el más feliz te dice como la película Her. Todo el storytelling de la ciencia ficción, que todos los que estamos en esto somos fanáticos.Lo que sucede es que a los grandes medios les cuesta discernir. Y hay un poco de vagancia también para entender qué es.

LINO: No son tiempos para entender estos, sino para pegar en quince segundos, por eso justamente queríamos contactarte.

GALA: La tecnología en sí ya viene con el vicio de ser un gadget, viene con esa lavada de contenido. Y hay vagancia para entender otros matices culturales, sociales y políticos que implican. Por lo menos en los grandes medios. Después en fondos académicos, experimentales o artísticos se explora mucho más en profundidad.

LINO: Pero con la crisis de confiabilidad que hay, ¿qué importa lo que dicen los científicos en las revistas?

GALA: Claro, sí. Total.

LINO: Son tiempos de superstición aumentada y a mí me cuesta mucho ser optimista. Es estándar que nuestros chicos silabeen a los diez y los estudiantes de grado carezcan de comprensión lectora.

GALA: Sí.

LINO: Me parece espeluznante. Quiero preguntarte ¿cómo la ves?

GALA: Últimamente hago un esfuerzo para seguir activando estas conversaciones y no tener una mirada tan pesimista. Yo sé que las cosas están críticas. Eso es una motivación para activar movimientos para que las cosas cambien.

LINO: Uhum.

GALA: Pero si me quedo en el pesimismo dejo de hacer también ¿viste?

LINO: Uhum.

GALA: Por eso intento salir y mirar adónde sí y alimentar esas historias. Apoyar a las personas que están activando y que les importa. Hacer red. Intentar llegar por la positiva a las personas, ¿no?

LINO: Claro.

GALA: No hablar sobre lo que están perdiendo sino sobre lo que pueden ganar.

LINO: Si le hablas críticamente desde una supuesta superioridad a alguien capaz se radicaliza en su posición, o lo toma a mal.

GALA: Y… es complicado eso, ¿viste? Marcarle el punto a las personas. O decirle a toda una generación de repente que no saben leer. Es como fuerte. Es desvalorizar. No ayuda mucho ese análisis.

LINO: La lectura de vaso medio vacío.

GALA: Sí, pero es algo muy personal y que vengo trabajando. De lo que me toca que es el ecosistema tecnológico. Ahora veo que se presta mucha más atención a las dimensiones sociales y políticas. Pero con un sesgo negativo: todas estas empresas tienen el poder. Así se da un poco por perdido el partido.

LINO: Esta visión de que un gordo puede apretar un botón y terminar con todo.

GALA: Jaja, claro. Y todavía falta la mirada desde las ciudadanías y desde las redes. De otras formas de habitar y de crear. Yo ya estoy podrida de lo que hace Elon Musk, Mark Zuckerberg, Jeff Bezos. Ya no los quiero ni nombrar.

LINO: Y es de lo que no dejamos de hablarte.

GALA: Obviamente siempre voy a seguir odiando a los CEO pero me gusta mucho visibilizar personas que hacen cosas desde acá y que son cosas re piolas.

LINO: Una visión situada. Me has hecho verle el costado colonialista a esto de decir hay una generación que no sabe leer. Tampoco hay que dejar que la mierda nos tape hasta el cuello. Por eso los estados se están poniendo al día. Hay juicios en curso, medidas en ejecución.

GALA: Hace poco terminé de leer un libro. Poder inhumano. Inteligencia artificial y el futuro del capitalismo y es bastante académico. Tiene una mirada marxista. Está muy bueno. Es del 2019. Hay muchos puntos que analiza que se pueden considerar predicciones porque ya pasaron.

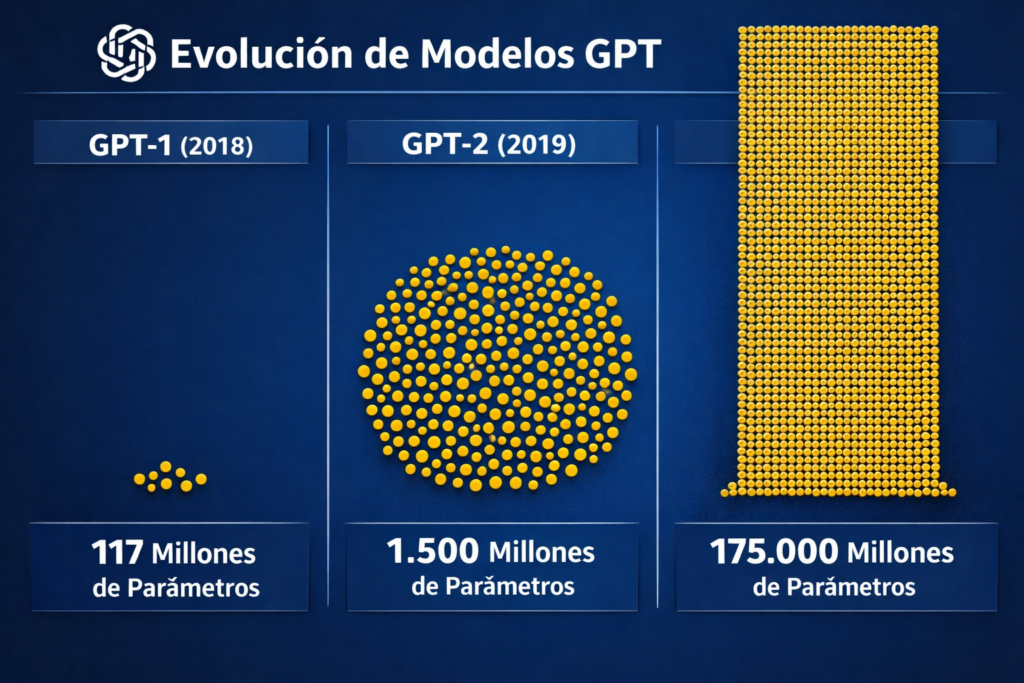

LINO: No sé si existían los LLM (Modelos extensos de lenguaje, por sus siglas en inglés), tales como Claude, GPT, Gemini, Llama[9].

GALA: No existía lo que hoy denominamos inteligencia artificial generativa. El libro también habla de la emulación de procesos cognitivos. De personas entrenando a las máquinas que las van a reemplazar.

LINO: Cuando imprimamos con máquinas 3D tejido humano y le instalemos IA van a empezar los problemas y las preguntas si acaso eso siente el error y por eso lo evita. Si es sintiente, si vive. Siempre iremos corriendo la bocha. Gracias por la palabra y la predisposición. Hoy más que nunca necesitamos esa integridad a la hora de pensar y de decir.

GALA: Estuvo buena la conversación. Cuenten conmigo en adelante.

[1] @chip.tecno https://www.youtube.com/@chiptecno

[2] Cambió de nombre varias veces, de Clawdbot a Moltbot, y de ahí a OpenClaw

[3] https://simonwillison.net/2026/Jan/30/moltbook/

[4] N. del E.: una API es una forma estandarizada de pedirle algo a otro sistema sin meterse en su funcionamiento interno.

[5] N. del E.: un token es la unidad básica de texto que la IA procesa y que determina cuánto cálculo —y por lo tanto cuánto consumo y costo— se genera.

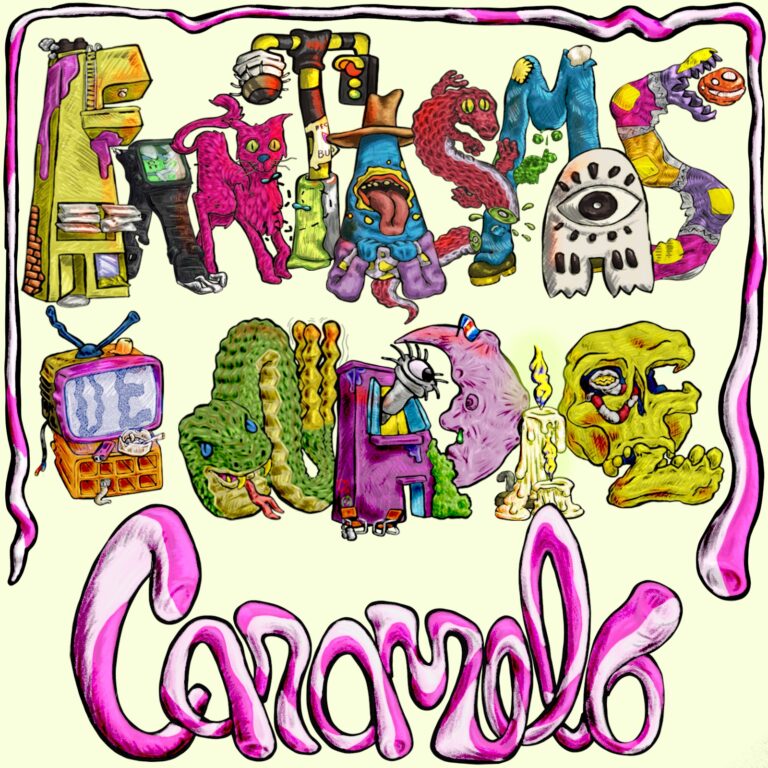

[6] En el CHIP CHAT #2 Gala conversa con Karen Palacio y David Coronel, especialistas en IA y programación. David decía que parecía vibecodeada y que él elegía tomárselo como un ARG (Juego de realidad alternativa por sus siglas en inglés). Karen por su parte comentaba de una súper producción india de chatbots programados para postear sobre tal o cual cosa. Y Gala nombró a Gal Nagli quien cuestionó en X la narrativa viral sobre la autonomía de esos agentes supuestamente independientes. Él habla también de la memecoin $MOLT que se recontra infló con todo el hype de los últimos días.

[7] https://www.youtube.com/live/U04chixyzUg

[8] N. del E.: Inteligencia artificial general es una IA capaz de comprender, aprender y aplicar conocimiento en cualquier dominio intelectual, con un nivel de flexibilidad y adaptación comparable al de un ser humano, en oposición a las IA que tenemos ahora que son más bien estrechas o especializadas

[9] N. del E.: El primer modelo de GPT es de 2018 y ya se lo podría considerar un LLM, ese tenía 117 millones de parámetros. El asunto escaló y generó preocupación su versión 2 en 2019, ese tenía 1.5 mil millones de parámetros pero recién en simultáneo con la aparición del modelo 3 en 2020 se estandarizó el uso del concepto de LLM en papers y en la prensa.